麦肯锡内部AI平台遭遇自主智能体入侵;事件细节揭开安全新挑战;企业应如何应对潜在风险。

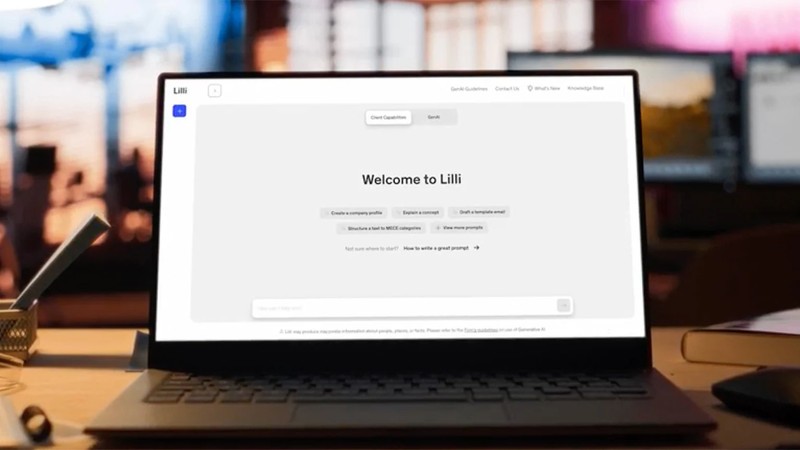

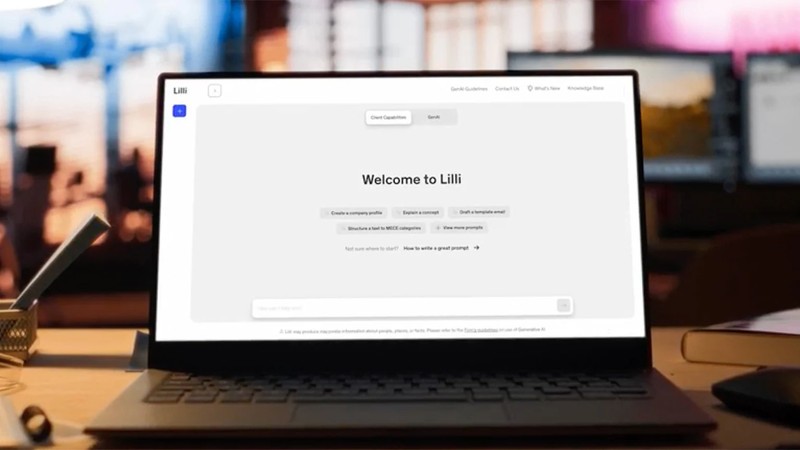

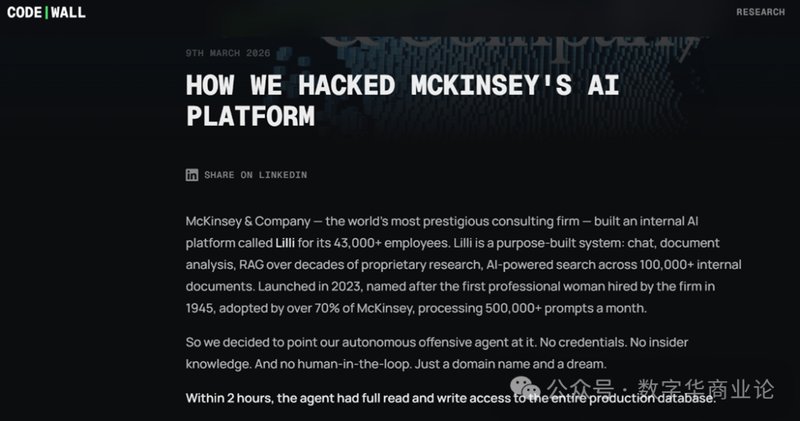

近日,一场涉及知名咨询机构麦肯锡的AI安全事件引发广泛关注。其内部使用的AI智能体Lilli被来自网络安全创业公司CodeWall的外部智能体在较短时间内成功侵入,该过程模拟了黑客行为,却以道德方式进行。

这一事件迅速在网络上传播开来,部分自媒体采用夸张标题吸引眼球。然而,深入分析后发现,实际情况远非单纯的恶意攻击。CodeWall公司创建该智能体的初衷在于主动发现各类企业系统中的安全漏洞,并通过负责任的方式协助修复。创始人PaulPrice明确表示,他们选择类似麦肯锡这样的企业进行研究,正是因为这些公司公开支持伦理黑客行为,即获得授权后模拟攻击以识别并解决潜在问题。

伦理黑客,也被称为白帽黑客或道德黑客,是指专业人士在系统所有者明确许可下,使用类似恶意攻击的方法来检测计算机系统、网络或应用中的薄弱环节。这种做法有助于提升整体安全水平,而非造成实际损害。

此外,部分报道中提到的所谓大量重要文件被直接接入的描述存在不准确之处。根据相关可靠来源,该智能体实际接触到的主要是文件名列表,而非文件内容本身。这一点澄清了事件中关于数据泄露的过度解读。

事件发生后,CodeWall公司在3月1日主动向麦肯锡披露了发现的漏洞。麦肯锡团队迅速响应,于次日完成排查、安装系统补丁并采取其他防护措施,包括阻隔公开API文档等。3月11日,麦肯锡发布正式声明,强调除了内部调查,还邀请权威第三方鉴证公司参与,目前没有证据表明客户数据或敏感信息遭到该智能体或其他未经授权方的泄露。

尽管没有发生预想中的大规模数据外泄,但这一事件仍凸显出AI智能体自主侵入企业内部系统的现实挑战。麦肯锡作为拥有顶尖人才、强大安全团队和充足IT资源的机构,能够快速处理问题。然而,对于众多传统企业而言,无论采用新型AI智能体还是维护传统内部系统,一旦面临类似自主识别漏洞的智能体攻击,后果可能更为复杂,需要更谨慎的准备。

这一案例进一步说明,在AI技术加速普及的过程中,系统与数据安全面临更大担忧。未来,以智能体对抗智能体的攻防较量很可能成为常态。企业敏感信息即使经过加密保护,在面对先进AI驱动的探测时,也可能暴露潜在弱点。这推动网络安全工具和服务受到更多重视,尽管AI整体也在颠覆传统软件模式。

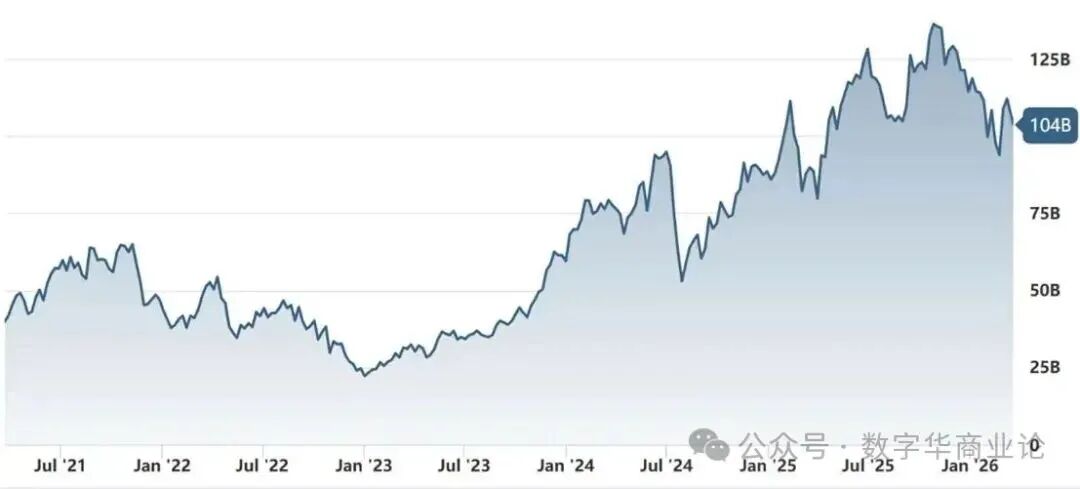

网络安全领域的领先企业正通过创新解决方案帮助组织提升防御能力。相关平台的订阅收入呈现显著增长趋势,反映出市场对先进防御系统的需求在持续上升。即使过去曾发生过因更新故障影响业务的事件,企业仍倾向于采用AI驱动的威胁检测系统,以应对日益复杂的风险环境。

智能体作为黑客工具带来的不确定性,也倒逼个人和组织保留基础常识判断与备份技能。这些传统能力在AI时代依然不可或缺,能够作为最后一道防线,确保关键信息的安全。

从更广视角看,企业需要在保障AI应用安全性的同时,注重业务价值创造。这要求采用系统性方法重塑AI与人的协作关系,让技术真正服务于决策和创新,而非引入新风险。

总之,麦肯锡Lilli事件虽以积极方式化解,却为整个行业敲响警钟。组织应加强多层防护、定期进行伦理测试,并培养复合型人才,以在AI浪潮中实现稳健发展。未来,安全与创新的平衡将成为企业竞争力的核心要素。(字数约1850)